Bausteine für den verantwortungsvollen Einsatz von KI

Drei Bausteine bilden die Grundlage für eine KI-Governance: Dokumentation von KI-Projekten, Model Evaluation und Monitoring sowie regulatorische Compliance.

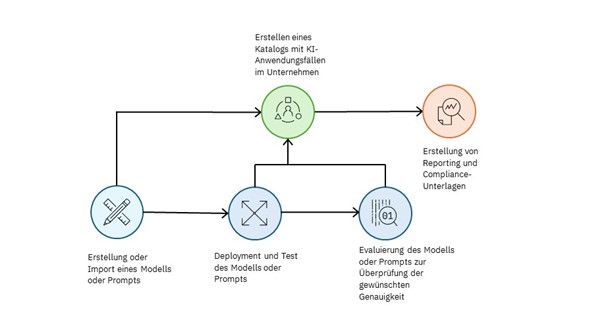

Die Einigung auf den EU AI Act Ende 2023 wird zurecht als historisch bezeichnet – schafft sie doch die Grundlage für die Regulation des Einsatzes von KI in Unternehmen, im Einklang mit Datenschutz, Ethik und Verbraucherschutz. Schon bis zum Jahresende müssen Unternehmen ihre KI-Anwendungen katalogisieren, wie der Überblick zeigt. Dabei hilft ihnen eine klar definierte AI-Governance-Strategie. Darunter versteht man die Prozesse und Werkzeuge, die einen effektiven und vor allem transparenten Einsatz von KI-Systemen im Unternehmen ermöglicht und nachvollziehbar macht.

Governance, Ethik und Sicherheit stehen ganz oben auf der Agenda der deutschen Führungskräfte, die sich bemühen, KI sicher und verantwortungsvoll einzusetzen. Laut der IBM Studie „Leadership in the age of AI“ setzen 82 Prozent der befragten deutschen Führungskräfte bereits KI ein oder wollen dies noch im Jahr 2024 tun. 93 Prozent von ihnen, beschäftigen sich – glücklicherweise – aktiv mit der Entwicklung neuer ethischer und regulatorischer Rahmenbedingungen. Um die Chancen von KI zu nutzen und gleichzeitig die Risiken der Technologie effektiv zu managen, kann eine AI-Governance-Plattform mit ihren Mitteln zur Überwachung von Modellen einen wesentlichen Beitrag liefern.

Was eine KI-Governance-Strategie leisten kann

KI-Governance sind Regeln, Richtlinien und Verfahren, die Unternehmen und Organisationen bei der verantwortungsvollen Nutzung von Künstlicher Intelligenz unterstützen. Es geht darum, sicherzustellen, dass KI-Systeme ethisch und verantwortungsvoll eingesetzt werden. Die Berechnungen und davon abgeleitete Entscheidungen von KI-Systemen sollen zudem nachvollziehbar werden, um durch Transparenz das Vertrauen der Nutzer zu gewinnen und potenzielle Risiken zu minimieren. Drei Bausteine stehen dabei im Fokus: Dokumentation von KI-Projekten, Evaluation und Monitoring sowie regulatorische Compliance.

Im Rahmen der Dokumentation von KI-Projekten, ist zunächst eine vollständige Katalogisierung aller AI Use Cases entscheidend. Ein solches „AI Use Case Inventory“ ist eine umfassende Übersicht oder ein Katalog von Szenarien, Aufgaben oder Problemen, für deren Bearbeitung Unternehmen künstliche Intelligenz nutzen. Diese Übersicht ist eine wichtige Grundlage, um KI transparent zu nutzen und die verwendeten Modelle und Machine-Learning-Komponenten lückenlos zu überwachen. In einem solchen Katalog können Unternehmen nicht nur ihre KI-Anwendungen speichern und katalogisieren, sondern auch die zugehörigen Daten, die bei der Evaluierung und Genehmigung von Modellen und Ansätzen angefallen sind.

Ein KI-Anwendungsfall im Katalog besteht aus einer Reihe von Metadaten, die die Aufgabenstellung, die Risikoeinstufung, den Verlauf und andere relevante Informationen über den Lebenszyklus eines Modells enthalten. Alle Projektbeteiligten – vom Projektverantwortlichen über den Data Scientist bis hin zum Entwickler – nutzen das Inventar für die Weiterentwicklung und Dokumentation der einzelnen Ansätze und Modelle zur Umsetzung des Use Cases. Einzelne Ansätze werden in Form von sogenannten Factsheets über ihren gesamten Lebenszyklus dokumentiert. Je nach Governance-Anforderung, können Unternehmen alle Anwendungsfälle in einem einzigen Katalog speichern oder mehrere Übersichten erstellen.

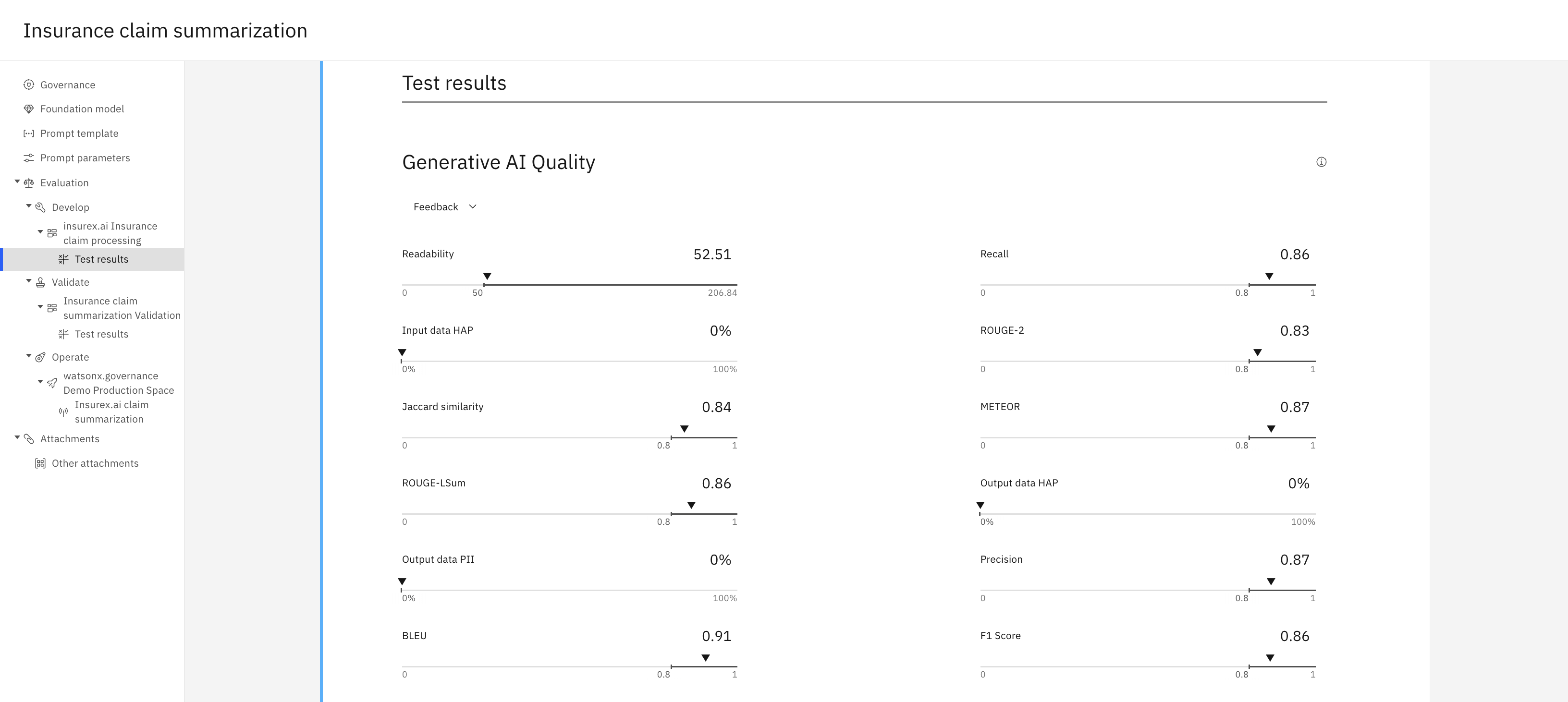

Der nächste Baustein einer AI Governance ist die Model Evaluation und das Monitoring: Idealerweise integriert in ein AI Use Case Inventory ist es notwendig, die genutzten oder mit Fine Tuning optimierten KI-Modelle bzw. daraus mit Hilfe von Prompt Templates abgeleiteten Lösungen zu evaluieren und zu überprüfen. Die Ergebnisse dieser Evaluierungen werden dann in Factsheets dokumentiert und enthalten Informationen wie Methodik der Evaluation, Modell-Details sowie die verwendeten Prompt-Parameter. Werden die Prompts mit der ausreichenden Genauigkeit ausgeführt? Produziert das Modell keine Inhalte, die schädlich oder unangemessen sind? Führende AI-Governance-Tools wie IBM watsonx.governance bieten für die Evaluierung eine große Auswahl an verschiedenen Werkzeugen und Metriken, um anhand der zugrundeliegenden Aufgabe die Lösungen zu überprüfen und damit hohe Qualität sicher zu stellen. Das Ergebnis wird als Factsheet Teil des KI-Katalogs und die Qualität lässt sich so jederzeit überprüfen, auditieren und laufend überwachen. Erfüllt das Modell nicht die gewünschte Qualität, kann das verantwortliche Team eine Alternative entwickeln.

Ebenfalls Teil einer AI Governance sollte die regulatorische Compliance sein: Der EU AI Act hat zum Ziel, das Vertrauen der Verbraucher und Verbraucherinnen in KI-Anwendungen zu stärken und gleichzeitig den Schutz ihrer Rechte gewährleisten. Auch wenn das Gesetzesvorhaben eines der ersten seiner Art ist – es ist bei weitem nicht das einzige. Die USA, Kanada und einige Staaten im asiatisch-pazifischen Raum haben ebenfalls Regularien für KI auf den Weg gebracht – und diese werden sich – genau wie die Technologie selbst – weiterentwickeln. Um bei der Geschwindigkeit der technologischen und regulatorischen Entwicklung auf der Höhe zu bleiben, sollten Unternehmen in ihrer AI-Governance-Strategie auf Werkzeuge und Plattformen setzen, die das Thema regulatorische Compliance abdecken. Dabei helfen ihnen Lösungen, die einerseits die Anforderungen kontinuierlich betrachten und Anpassungen und Neuerungen in den Regularien erfassen und sie mittels Automation in einer zentralen Plattform bündeln und umsetzen. Hier lassen sich interne Risiken durch Regularien schnell ermitteln, transparent vorhalten und bei Bedarf mit wenigen Klicks umsetzen bzw. reporten. Eine solche Plattform ist watsonx.governance von IBM – sie wurde von der IDC 2023 als führende Plattform ausgezeichnet und überzeugt vor allem durch ihr offenes Konzept: Mit ihr verwalten Unternehmen KI-Modelle von IBM, aber auch die von Drittanbietern wie AWS, Azure und OpenAI.

KI-Governance als Chance verstehen

Viele Unternehmen sind offen für KI-Lösungen, stehen bei der Implementierung aber vor großen Herausforderungen, etwa ethischen Bedenken. Dies ist nachvollziehbar, aber aus unternehmerischer Sicht sind die Möglichkeiten, die KI bietet zu groß und die Kräfte der globalen Wirtschaft zu gewaltig, um sie nicht zu ergreifen. Daher sollten Unternehmen KI-Governance als Chance für eine bessere Qualität zu verstehen. Durch eine angemessene KI-Governance können sie sicherstellen, dass die Daten der Nutzer angemessen geschützt, nur für legitime Zwecke verwendet werden und gleichzeitig hochqualitative Lösungen geschaffen werden. Mit der Wahl der richtigen Plattform kommen sie bereits jetzt den Forderungen des EU AI Act entgegen. Die hier genannten Bausteine KI-Dokumentation, Modell-Evaluation und regulatorische Compliance ebnen den Unternehmen also den Weg, um KI für Ihre Zwecke zu nutzen und dabei verantwortungsvoll mit der Technologie umzugehen.

![]()

ist Director Software Technical Sales DACH bei IBM.