Künstliche Intelligenz ist das Hauptthema auf der diesjährigen Cyber Week vom 19. bis 21. November in Rennes, Bretagne. In einer Herausforderung, die von der französischen Agentur für Verteidigungsinnovation (AID) für diese Veranstaltung organisiert wurde, entwickelten Thales-Teams erfolgreich ein Metamodell zur Erkennung von KI-generierten Bildern. Da der Einsatz von KI-Technologien immer weiter zunimmt und in einer Zeit, in der Fehlinformationen vermehrt in den Medien verbreitet werden, was Einfluss auf jeden Wirtschaftssektor hat, bietet das Metamodell zur Deepfakeerkennung einen Weg, Bildmanipulationen in vielfältigen Anwendungsfällen wie dem Kampf gegen Identitätsbetrug zu bekämpfen.

Diese Pressemitteilung enthält multimediale Inhalte. Die vollständige Mitteilung hier ansehen: https://www.businesswire.com/news/home/20241120112186/de/

(c)Thales

KI-generierte Bilder werden mithilfe von KI-Plattformen wie Midjourney, Dall-E und Firefly erstellt. Einige Studien haben vorhergesagt, dass innerhalb von fünf Jahren die Nutzung von Deepfakes für Identitätsdiebstahl und Betrug zu riesigen finanziellen Verlusten führen könnte. Gartner schätzte, dass ca. 20 % der Cyberangriffe im Jahr 2023 wahrscheinlich Deepfakeinhalte im Rahmen von Fehlinformationen und Manipulationskampagnen enthielten. Ihr Bericht1 verdeutlicht den Anstieg der Nutzung von Deepfakes bei finanziellem Betrug und ausgefeilten Phishing-Angriffen.

„ Thales Metamodell zur Deepfakeerkennung richtet sich an das Problem des Identitätsbetrugs und an Morphing-Techniken, “2 sagte Christophe Meyer, Senior Expert bei AI und CTO von cortAIx, Thales KI-Beschleuniger . „Der Einsatz mehrerer Methoden mithilfe neuronaler Netze, Rauschdetektion und räumlicher Frequenzanalyse hilft uns dabei, die zunehmende Anzahl von Lösungen, welche biometrische Identitätsprüfungen erfordern, besser zu schützen. Dies ist ein bemerkenswerter Technikfortschritt sowie ein Beweis für die Expertise der KI-Forscher von Thales. “

Das Metamodell von Thales nutzt Techniken des maschinellen Lernens, Entscheidungsbäume sowie Bewertungen der Stärken und Schwächen jedes Modells zur Analyse der Authentizität eines Bildes. Es kombiniert verschiedene Modelle, wie zum Beispiel:

- Die CLIP-Methode (Contrastive Language-Image Pre-training) beinhaltet die Verknüpfung von Bild und Text, indem sie übliche Darstellungen lernt. Um Deepfakes zu erkennen, analysiert die CLIP-Methode Bilder und vergleicht diese mit ihren Textbeschreibungen, um Nichtübereinstimmungen und visuelle Artefakte zu identifizieren.

- Die Methode DNF (Diffusion Noise Feature) nutzt aktuelle Bildgenerierungsarchitekturen (Diffusionsmodelle genannt), um Deepfakes zu erkennen. Diffusionsmodelle basieren auf einer Schätzung der Rauschmenge, die einem Bild hinzugefügt werden muss, um eine „Halluzination“ zu erzeugen, welche Inhalte aus dem Nichts erschafft und diese Schätzung kann wiederum genutzt werden, um festzustellen, ob ein Bild von einer KI generiert wurde.

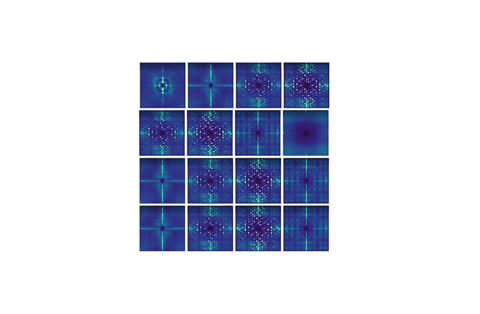

- Die Methode DCT (Discrete Cosine Transform) zur Deepfakeerkennung analysiert die räumlichen Frequenzen eines Bildes, um versteckte Artefakte zu erkennen. Durch die Umformung eines Bildes von der räumlichen Domäne (Pixel) in den Frequenzbereich kann DCT subtile Anomalien in der Bildstruktur erkennen, die bei der Erstellung von Deepfakes auftreten und für das bloße Auge häufig unsichtbar sind.

Das Team von Thales hinter der Erfindung ist Teil von cortAIx, dem KI-Beschleuniger der Gruppe, der über 600 KI-Forscher und -Ingenieure beschäftigt, von denen 150 im Forschungs- und Technologiecluster Saclay südlich von Paris an unternehmenskritischen Systemen arbeiten. Das Team von „Friendly Hackers“ entwickelte eine Toolbox mit dem Namen „BattleBox“, um die Robustheit von KI-gestützten Systemen gegenüber Angriffen zu bewerten, die darauf abzielen, die intrinsischen Schwachstellen verschiedener KI-Modelle (einschließlich großer Sprachmodelle) wie feindliche Angriffe und Versuche, sensible Informationen zu extrahieren auszunutzen. Um diesen Angriffen die Stirn zu bieten, entwickelt das Team fortschrittliche Gegenmaßnahmen wie das Verlernen, das föderierte Lernen, das Modell-Wasserzeichen und die Modellfestigung.

2023 stellte Thales seine Expertise während der CAID-Veranstaltung (Conference on Artificial Intelligence for Defence), welche von der französischen Beschaffungsbehörde für Verteidigungsgüter (DGA) organisierte wurde und bei der es darum ging, KI-Trainingsdaten zu finden, selbst nachdem sie zur Wahrung der Vertraulichkeit aus dem System gelöscht worden waren.

Über Thales

Thales (Euronext Paris: HO) ist ein weltweit führendes Unternehmen für fortschrittliche Technologien, das auf drei Geschäftsbereiche spezialisiert ist: Verteidigung und Sicherheit, Luft- und Raumfahrt sowie Cybersicherheit und Digitale Identität.

Die Gruppe entwickelt Produkte und Lösungen, die dabei helfen, die Welt sicherer, grüner und inklusiver zu machen.

Thales investiert jährlich fast 4 Milliarden Euro in Forschung und Entwicklung, insbesondere in wichtige Innovationsbereiche wie KI, Cybersicherheit, Quantentechnologien, Cloud-Technologien und 6G.

Thales hat 81 000 Beschäftigte in 68 Ländern. 2023 erwirtschaftete die Gruppe einen Umsatz von 18,4 Milliarden Euro.

BESUCHEN SIE

Entwicklung von KI-Systemen, auf die wir alle vertrauen können | Thales Group

12023 Gartners Bericht über neu auftretende Cybersicherheitsrisiken.

2Morphing verwandelt ein Gesicht schrittweise in ein anderes, indem es die visuellen Merkmale verändert, um ein realistisches Bild zu erstellen, welches Elemente aus beiden Gesichtern kombiniert. Das Endergebnis sieht aus wie eine Mischung aus den beiden ursprünglichen Erscheinungsbildern.

Die Ausgangssprache, in der der Originaltext veröffentlicht wird, ist die offizielle und autorisierte Version. Übersetzungen werden zur besseren Verständigung mitgeliefert. Nur die Sprachversion, die im Original veröffentlicht wurde, ist rechtsgültig. Gleichen Sie deshalb Übersetzungen mit der originalen Sprachversion der Veröffentlichung ab.

Originalversion auf businesswire.com ansehen: https://www.businesswire.com/news/home/20241120112186/de/